La llegada de Qwen 3.5 marca un nuevo capítulo en la evolución de los modelos de lenguaje abiertos. Alibaba ha lanzado una familia completa de modelos que cubre desde variantes gigantes de cientos de miles de millones de parámetros hasta versiones optimizadas para dispositivos domésticos y edge computing.

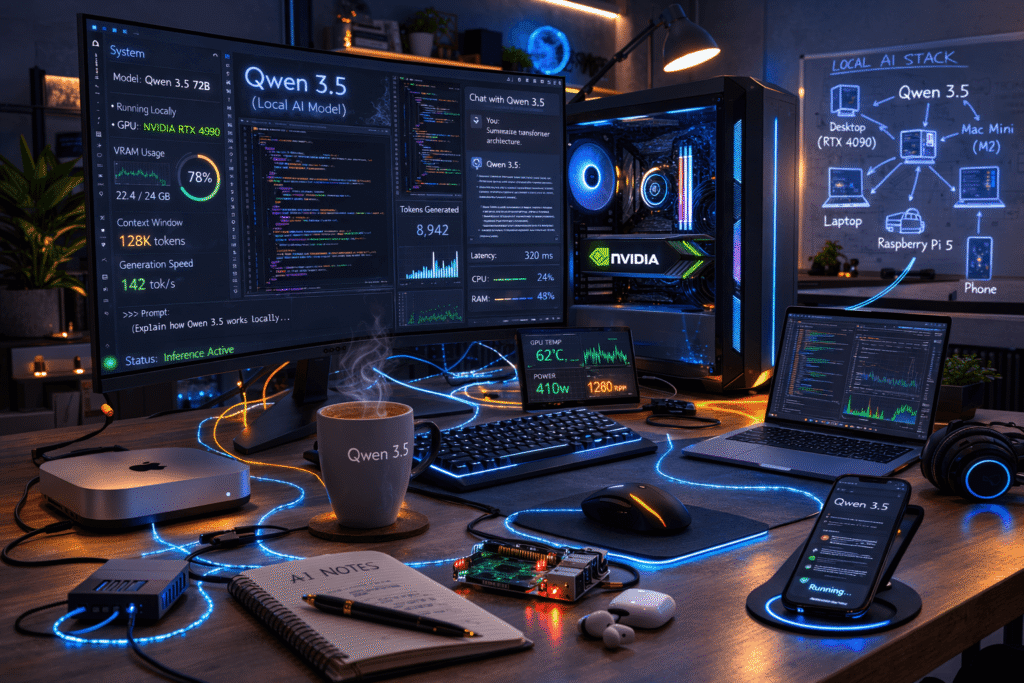

Esta guía completa te explico qué es Qwen 3.5, qué tamaños existen, cómo se comparan con generaciones anteriores, cómo ejecutarlos en local paso a paso con LM Studio y qué impacto pueden tener en dispositivos como laptops, GPUs de consumo o incluso Raspberry Pi.

¿Qué es Qwen 3.5?

Qwen 3.5 es la nueva generación de modelos de lenguaje desarrollados por Alibaba. Lo que diferencia este lanzamiento no es solo su rendimiento, sino su estrategia: en lugar de enfocarse en uno o dos tamaños específicos, el equipo ha publicado múltiples variantes que cubren prácticamente todo el espectro de uso.

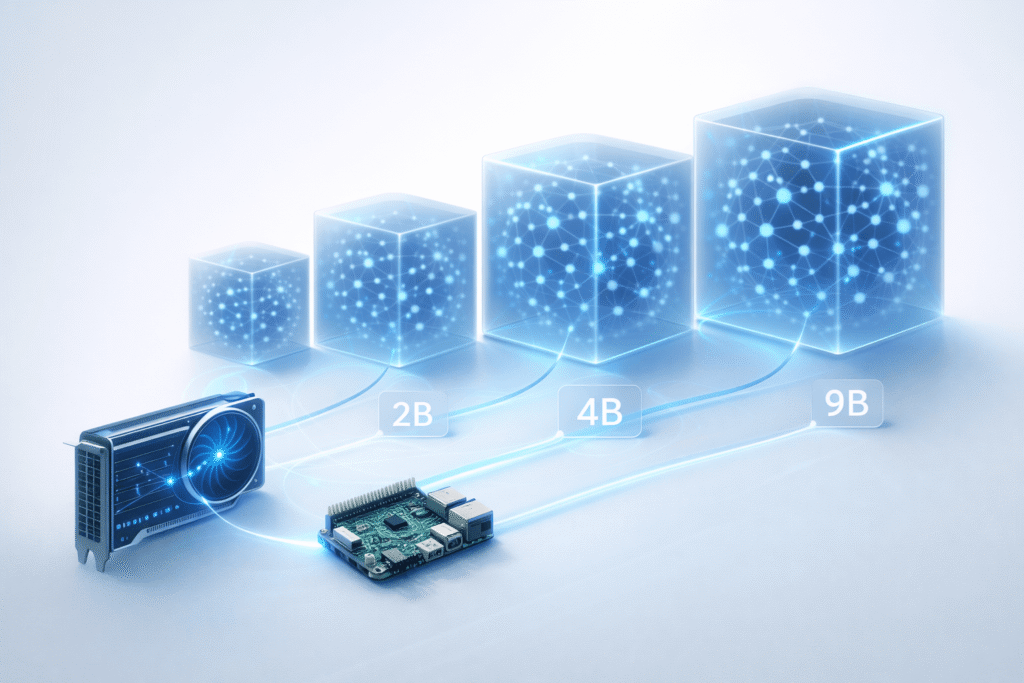

Entre los tamaños disponibles encontramos:

- 800 millones de parámetros

- 2 mil millones

- 4 mil millones

- 9 mil millones

- Versiones superiores en generaciones anteriores (hasta 235B)

Este enfoque permite que tanto usuarios de servidores empresariales como entusiastas con GPUs domésticas puedan utilizar la misma familia de modelos.

A diferencia de otros laboratorios que priorizan modelos frontier extremadamente grandes, Qwen apuesta por la diversificación de tamaños, lo que abre la puerta a nuevos casos de uso en edge computing.

La estrategia de lanzamiento de Alibaba

Alibaba ha optado por lo que podríamos llamar un enfoque “shotgun”: cubrir todo el rango posible de tamaños de modelo.

Mientras otros laboratorios lanzan un modelo insignia y lo optimizan durante meses, Qwen publica múltiples tamaños simultáneamente. Esto tiene implicaciones claras:

- Adaptabilidad a distintos tipos de hardware

- Democratización del acceso a modelos avanzados

- Mayor experimentación en dispositivos locales

Además, Qwen tiende a tener ciclos de lanzamiento más pausados en comparación con otros actores del sector, aunque cuando publica nuevas versiones, lo hace de manera amplia y estratégica.

Densidad de Inteligencia en Qwen 3.5

Uno de los conceptos más interesantes asociados a Qwen 3.5 es la llamada “densidad de inteligencia”.

Evolución en el rango 9B–12B

Si analizamos modelos entre 9 y 12 mil millones de parámetros:

| Año | Modelo | Parámetros |

|---|---|---|

| 2023 | Llama 2 | 13B |

| 2024 | Gemma 2 | 9B |

| 2025 | Gemma 3 | 12B |

| 2026 | Qwen 3.5 | 9B |

Lo interesante es que el tamaño se ha mantenido relativamente estable, pero el rendimiento en benchmarks como MMLU ha mejorado con el tiempo.

Esto demuestra que:

- La arquitectura ha mejorado

- Las técnicas de entrenamiento son más eficientes

- Se utilizan datasets de mayor calidad

- Hay mayor estabilización durante el entrenamiento

En otras palabras, hoy se puede “empaquetar” más capacidad cognitiva en el mismo número de parámetros que hace tres años.

Según documentación técnica pública de benchmarks como MMLU (Massive Multitask Language Understanding), el rendimiento en tareas académicas generales ha aumentado de forma sostenida en modelos de tamaño medio.

¿Por qué los modelos pequeños son estratégicos?

Muchos usuarios buscan modelos state-of-the-art gigantes en la nube. Sin embargo, el verdadero impacto puede estar en los modelos pequeños.

Edge Devices y privacidad

Modelos de 0.8B, 2B o 9B pueden ejecutarse en:

- GPUs de consumo (RTX 3060, por ejemplo)

- Mac Mini

- Laptops con suficiente RAM

- Smartphones avanzados

- Raspberry Pi (modelos más pequeños)

Esto implica:

- Privacidad total (sin envío de datos a APIs externas)

- Funcionamiento offline (avión, zonas sin conexión)

- Baja latencia

- Coste cero por uso

Para muchos usuarios, esto es más valioso que tener el modelo más potente disponible en la nube.

Comparación con generaciones anteriores de Qwen

Qwen ya había lanzado:

- Qwen 2 (0.5B hasta 72B)

- Qwen 2.5

- Qwen 3 (0.6B hasta 235B)

Lo interesante es que el modelo Qwen 3.5 de 9B puede competir “neck to neck” con modelos mucho más grandes de generaciones anteriores, como variantes de 80B o incluso superiores.

Esto sugiere:

- Mayor eficiencia arquitectónica

- Mejor uso de tokens de entrenamiento

- Distillation y data augmentation más refinados

Requisitos de Hardware para Ejecutar Qwen 3.5 en Local

GPU de Consumo (Ejemplo RTX 3060)

En pruebas locales con una Nvidia RTX 3060:

- Modelo: Qwen 3.5 9B

- Tamaño aproximado: 6 GB

- Tokens por segundo: ~37 t/s

- Offload completo en GPU

Esto ofrece una experiencia rápida para tareas generales.

Memoria RAM en Mac

En equipos Mac:

- Cuanta más RAM, mejor rendimiento

- El modelo debe convivir con el sistema operativo

- Un modelo de 6GB no implica que 6GB sean suficientes

Modelos de 22GB requieren configuraciones más robustas.

Cómo Instalar Qwen 3.5 en Local con LM Studio

Paso 1 – Descargar LM Studio

LM Studio está disponible para:

- Windows

- macOS

El proceso de instalación es sencillo:

- Descargar desde la web oficial: https://lmstudio.ai/download

- Ejecutar instalador

- Seguir pasos estándar

Paso 2 – Buscar Qwen 3.5 en el Model Browser

Dentro de LM Studio:

- Abrir Model Browser

- Buscar “Qwen 3.5”

- Seleccionar la variante deseada (ejemplo: 9B)

Paso 3 – Configurar GPU Offload

Opciones disponibles:

- Full GPU Offload

- Partial GPU Offload

En una RTX 3060 es posible cargar completamente el modelo 9B en GPU.

Paso 4 – Descargar y Ejecutar

Una vez descargado:

- Iniciar nuevo chat

- Verificar velocidad de tokens por segundo

- Evaluar rendimiento

Al ejecutarse, el equipo puede aumentar ruido (“whirring”), ya que el modelo consume recursos de GPU intensivamente.

Rendimiento y Tokens por Segundo

La velocidad se mide en tokens por segundo (t/s).

- Más tokens por segundo = respuestas más rápidas

- Modelos pequeños = mayor velocidad

- Modelos grandes = mayor precisión potencial, pero más lentos

En pruebas, Qwen 3.5 9B mostró un rendimiento fluido en generación básica.

Pruebas Básicas de Evaluación

En pruebas simples:

- Preguntas generales funcionan correctamente

- Generación de planes (ejemplo: dieta keto) responde rápido

- Algunas preguntas complejas pueden activar modos de “thinking” más lentos

Desactivar modos de razonamiento profundo puede acelerar respuestas.

Esto demuestra que, aunque el rendimiento bruto es bueno, aún existen variaciones en estabilidad según el tipo de pregunta.

IoT y Raspberry Pi: El Futuro del Edge AI

Uno de los puntos más interesantes es el potencial en dispositivos IoT.

Tradicionalmente, los dispositivos IoT:

- Solo recolectan datos

- Envían información a un servidor central

- No procesan localmente por limitaciones de hardware

Con modelos de 0.8B:

- Se podría procesar visión multimodal en el borde

- Analizar imágenes localmente

- Reducir latencia

- Mejorar privacidad

En dispositivos como Raspberry Pi 4 o 5 con distintas configuraciones de memoria, podrían abrirse nuevos escenarios donde el procesamiento ocurra directamente en el edge.

Qwen 3.5 vs Modelos en la Nube

Ventajas del modelo en la nube:

- Mayor inteligencia en modelos frontier

- Sin consumo de recursos locales

Ventajas del modelo local:

- Privacidad total

- Sin coste por uso

- Funciona offline

- Control absoluto del entorno

La decisión depende del caso de uso.

Impacto en el Mercado

El lanzamiento simultáneo de múltiples tamaños:

- Cambia la competencia

- Presiona a otros laboratorios

- Amplía el acceso a IA local

En un contexto donde se rumorea que otros actores preparan nuevos lanzamientos, esta estrategia masiva de tamaños podría redefinir el mercado intermedio.

Preguntas Frecuentes

¿Qwen 3.5 es gratuito?

Sí, Qwen 3.5 puede descargarse y ejecutarse en local sin coste por uso de tokens. Al funcionar directamente en tu equipo, no dependes de APIs externas ni de sistemas de pago por consumo.

¿Qué tamaño es recomendable para una RTX 3060?

La versión de 9 mil millones de parámetros (aproximadamente 6GB) es una opción equilibrada para una RTX 3060. Permite realizar full GPU offload y obtener una buena velocidad en tokens por segundo sin saturar completamente la memoria.

¿Se puede usar Qwen 3.5 en un Mac Mini?

Sí, es posible ejecutarlo en un Mac Mini. El rendimiento dependerá principalmente de la cantidad de memoria RAM disponible. A mayor RAM, mayor capacidad para cargar modelos más grandes y obtener mejor desempeño.

¿Es mejor Qwen 3.5 que los modelos grandes en la nube?

Depende del caso de uso. En términos de privacidad, coste y uso offline, ejecutar Qwen 3.5 en local tiene ventajas claras. Sin embargo, los modelos frontier en la nube suelen ofrecer mayor capacidad en tareas extremadamente complejas.

¿Puede ejecutarse sin conexión a internet?

Sí. Una vez descargado el modelo, puede utilizarse completamente offline, lo que lo hace ideal para entornos con conectividad limitada o donde se prioriza la privacidad.

¿Sirve Qwen 3.5 para proyectos IoT?

Las versiones más pequeñas, como la de 0.8B, pueden ser candidatas interesantes para edge computing e IoT, especialmente cuando se necesita procesamiento local, baja latencia y mayor control de los datos.

En resumen, Qwen 3.5 destaca por su estrategia de lanzar varios tamaños de modelos, lo que facilita ejecutar IA en local con buena privacidad y coste cero. La variante 9B es un punto de equilibrio interesante para GPUs de consumo, mientras que las más pequeñas abren posibilidades reales en edge computing e IoT. Con herramientas como LM Studio, el proceso de instalación y prueba es accesible, y el rendimiento en velocidad puede ser muy competitivo si se elige el tamaño adecuado y se ajusta el uso de GPU y modos de razonamiento.

Si te ha gustado este artículo te interesará leer el siguiente: Qwen 2.5 Max